Aux côtés de quatre entreprises majeures de l’informatique (Facebook, Microsoft, Twitter et YouTube), la Commission Européenne a élaboré en mai 2016 un code de conduite vis-à-vis des messages incitants à la haine sur internet. La Maison de l’Europe de Rennes et Haute Bretagne fait le point sur cet engagement volontaire pris par ces grandes entreprises dans l’Union.

Un discours de haine illégal est défini comme l’incitation publique à la violence ou à la haine visant des personnes ou des groupes de personnes, définis sur la base de certaines caractéristiques, dont la race, la couleur, la religion, l’ascendance et l’origine nationale ou ethnique.

Dans le contexte des attentats de 2015, et de la prolifération des messages racistes et xénophobes sur le web, la Commission a voulu porter un message clair : l’Europe ne tolère pas la haine en ligne.

Depuis 2016, Instagram, Google +, Dailymotion, Snapchat, Jeuxvideo.com et depuis un mois, LinkedIn, se sont joints à ce code de conduite.

L’objectif :

L’Union Européenne attends de ces géants du numérique une modération efficace. Une réaction aux signalements de contenu illicite doit être faite en moins de 24 heures, couplée si nécessaire avec la suppression du contenu illicite ou son accès bloqué. Cette modération doit néanmoins se faire dans le respect de la liberté d’expression et elle doit proposer un feedback à l’usager qui a signalé un contenu, pour une transparence totale.

La mise en œuvre réelle du code est évaluée par des organisations civiles dans chaque pays de l’Union. Pour la France, lors de la dernière évaluation, ce sont la Ligue Internationale Contre le Racisme et l’Antisémitisme (LICRA) et la Plateforme PHAROS qui ont étudié la mise en œuvre réelle du Code. Ces organisations envoient des signalements réguliers aux entreprises et évaluent le temps pris à résoudre la situation ainsi que la qualité de l’information donnée à l’utilisateur signaleur.

Des ateliers et formations sont régulièrement organisés entre les parties prenantes pour réfléchir à des stratégies d’innovation et des campagnes numériques pour contrer les discours haineux.

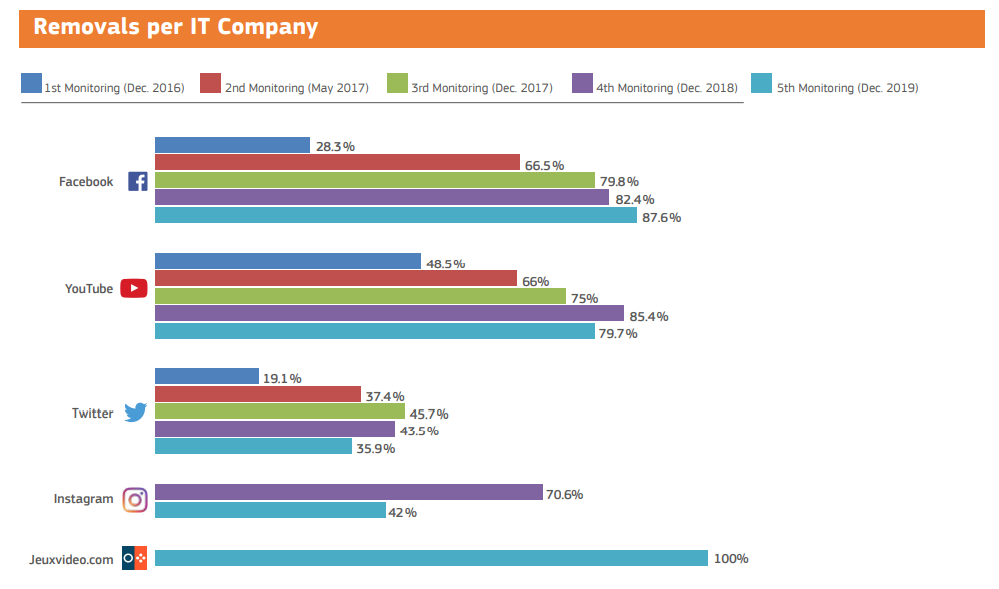

Résultats du dernier « monitoring » – Décembre 2019

Tous les résultats à retrouver juste ici : https://cutt.ly/zmAZBW6

En moyenne 90% des signalement sont étudiés en 24 heures, et 71% du contenu en question est supprimé.

Méthodologie : 39 organisations de 23 Etats-membre et du Royaume-Uni ont envoyé des signalements (4364 au total) pendant 6 semaines (4 novembre – 13 décembre 2019).

Suppression des contenus :

Le Code considère qu’un taux de suppression situé entre 70 et 80 % est satisfaisant, puisque tous les contenus signalés ne sont pas forcément illicites. La Commission le précise : « Les déclarations ou contenus offensants ou prêtant à controverse peuvent être légaux » (Bruxelles, le 22 juin 2020).

Les plus graves discours de haine considérés comme illégaux sont très largement supprimés. Les contenus incitants au meurtre ou à la violence contre un groupe donné sont supprimés rapidement. Les contenus peu supprimés sont ceux qui contiennent des propos à caractère diffamatoire ou dégradant.

Facebook est le grand champion du feedback en proposant une information systématique sur l’avancement du signalement aux utilisateurs, tandis que les autres entreprises affichent de moins bons résultats.

Facebook possède par ailleurs un réseau de + de 15 000 modérateurs !

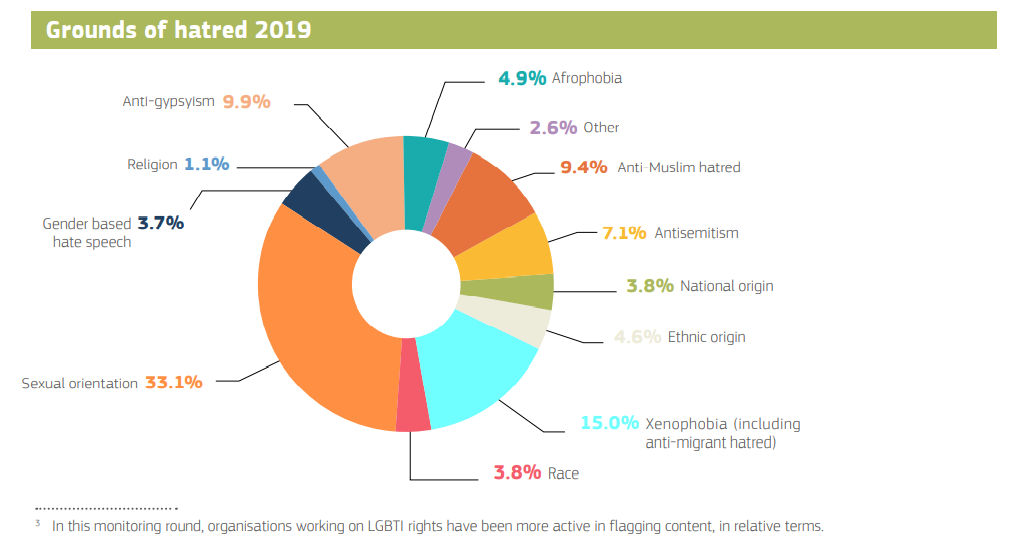

Contenu des signalements :

Par exemple : en 2019, sur 100 messages signalés, 33.1 messages portaient un contenu discriminatoire à l’égard des orientations sexuelles.

Klara Le Roch, stagiaire à la Maison de l'Europe de Rennes et Haute Bretagne